2025 年 8 月 7 日,Tailwind CSS联合创始人Adam Wathan在X平台发布了一条看似轻松的道歉推文:

"我想正式为五年前让Tailwind UI中的每个按钮都使用bg-indigo-500道歉,这导致地球上每个AI生成的界面也变成了靛蓝。"

这条推文迅速获得了68. 4 万次浏览,不仅因为其自嘲的幽默感,更因为它揭示了一个令人意外的技术现象:AI生成的用户界面普遍存在"紫色偏好"。

现象的具体表现

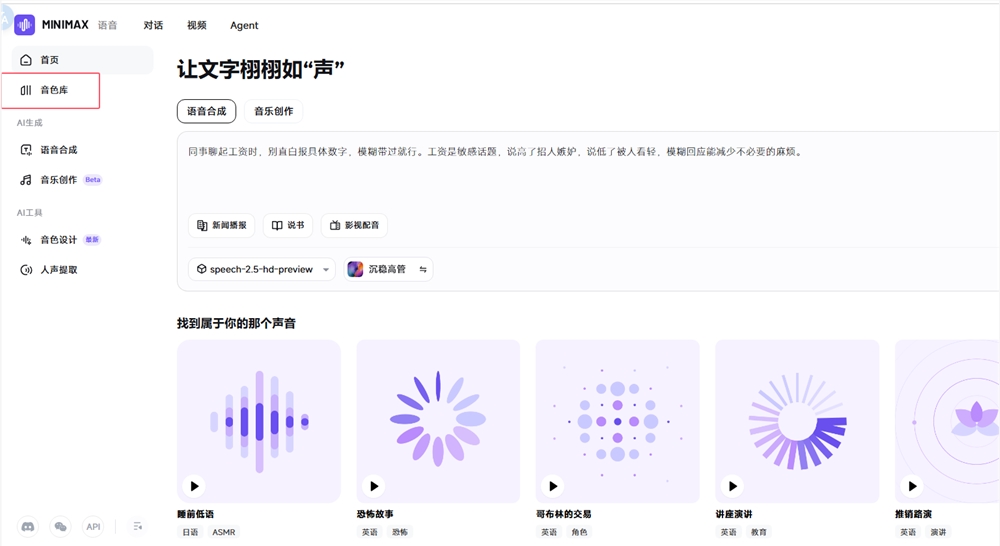

紧随其后,Kevin Kern通过回复推文进一步证实了这一现象。他分享了一张AI生成的法语学习应用"French Playground"的截图,界面中紫色元素随处可见——从按钮到整体配色方案。Kern调侃道:"所以,GPT- 5 还没有解决'紫色问题'。"

这款应用隶属于"巴黎午夜 – 一起学习"项目,其闪卡和测验功能不仅按钮采用紫色,整个设计美学都围绕这一色调展开,成为了"紫色困境"的典型案例。

技术成因:训练数据的意外偏差

8 月 8 日,X用户宝玉(@dotey)发布了一条详细分析,解开了这个现象背后的技术原理:

"现在AI生成的网页都喜欢用紫色,因为AI默认使用Tailwind CSS进行网页设计(因为原子化CSS不需要单独的CSS文件)。"

Tailwind CSS的"无心之过"

这一切要追溯到五年前Tailwind CSS的设计决策。作为实用优先CSS框架,Tailwind以其简洁的类名系统著称:

bg-indigo-500:那个"罪魁祸首"的靛蓝背景色

text-white:白色文字

p-4:内边距设置

这些可预测的类名让Tailwind成为AI工具的"宠儿",因为它们易于理解和生成。然而,正是这种便利性造成了意想不到的后果。

自强化循环的形成

问题的核心在于AI训练数据的构成:

1、初始偏差:早期大量网页使用Tailwind的默认紫色配置

2、数据污染:这些紫色界面成为AI训练数据的重要组成部分

3、模式固化:AI学会了"现代界面=紫色"的关联

4、循环强化:AI生成更多紫色界面,进一步"污染"网络内容

正如宝玉所指出的,这形成了一个"自我强化的循环"——AI不断复制和放大了人类早期的设计选择。

社区反应:从困惑到顿悟

这一现象在技术社区引发了广泛讨论,反应可谓五花八门:

恍然大悟派:

GNebula(@gyhjason):感谢解释,"难怪AI设计总是偏向紫色——我还以为是开发者的默认设置"

幽默调侃派:

烈焰童子(@TechMamiCom):认为这一情况"太搞笑了"

理性分析派:

Sherry Li(@SherryLi233812):指出紫色为设计增添了"科技感"

色彩心理学的意外印证

有趣的是,这种"紫色偏好"在某种程度上符合色彩心理学原理。紫色长期与以下特质相关联:

1、创造力与创新

2、技术感与未来感

3、神秘感与智能

对于AI驱动的平台而言,这些特质确实很契合。但问题在于,这种选择并非基于设计理论,而是训练数据偏差的意外结果。

技术影响与未来展望

当前挑战

这一现象揭示了AI辅助设计中的几个关键问题:

1、设计同质化风险:当所有AI生成的界面都趋向相似的色彩方案时,品牌差异化变得困难。

2、训练数据质量:过度依赖某些框架或设计模式可能导致输出结果缺乏多样性。

3、创新局限性:AI倾向于复制训练数据中的主流模式,而非探索新的设计可能性。

解决路径

短期策略:

1、开发者可以通过更具体的提示工程来指导AI生成不同色彩的界面

2、在AI生成后进行人工调整和优化

长期发展:

1、构建更平衡、多样化的训练数据集

2、开发上下文感知的AI设计系统

3、建立基于用户反馈的动态学习机制

结语:设计决策的蝴蝶效应

Wathan的那句轻松道歉,实际上触及了现代技术发展中一个深刻的现实:看似微不足道的早期决策可能在规模化应用后产生意想不到的长期影响。

"紫色困境"不仅是一个有趣的技术现象,更是对整个AI开发社区的提醒——我们需要更加审慎地考虑训练数据的代表性和多样性。随着GPT- 5 等下一代模型的发展,技术界正密切观察这一"靛蓝遗产"是否会持续,还是会让位于更丰富的设计调色板。

在那之前,开发者和AI爱好者或许只能接受这一"紫色迷雾"——至少这为我们提供了一个生动的案例,说明人类的设计选择如何通过机器学习模型得到意外的放大和延续。